Primer sistema de traducción de voz a la Lengua de Signos Española

Investigadores de la UPM y la Fundación CNSE desarrollan el primer sistema automático para la traducción de voz a la lengua de signos española (LSE) facilitando a las personas sordas la realización de trámites con la Administración.

La Fundación CNSE (Confederación Estatal de Personas Sordas) y la Universidad Politécnica de Madrid han desarrollado el primer sistema de traducción de voz a la lengua de signos española. Este sistema es capaz de traducir las expresiones pronunciadas por los funcionarios de la Administración Pública cuando atienden a una persona sorda que desea renovar el permiso de conducir o el Documento Nacional de Identidad (DNI). Con este desarrollo se ha dado un paso muy importante en el camino de eliminar las barreras de comunicación que encuentran las personas sordas al realizar este tipo de trámites administrativos.

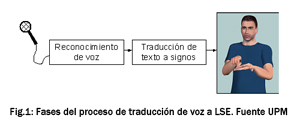

El sistema realiza el proceso de traducción en tres fases (Figura 1). En una primera fase se reconoce la voz del funcionario obteniendo la secuencia de palabras pronunciada. Seguidamente, se traduce la secuencia de palabras a glosas (representación escrita de los signos) y, finalmente, se representan los signos mediante un agente animado. Este agente animado utilizado fue desarrollado en el proyecto europeo eSign.

Para evaluar el sistema se utilizó éste en la Jefatura Provincial de Tráfico de Toledo con funcionarios y personas sordas, obteniendo unos resultados muy prometedores (Figura 2).

Con este proyecto, financiado por el Ministerio de Industria, Turismo y Comercio dentro del Plan Avanza, y la Fundación ONCE, se culmina un trabajo de investigación que, desde hace años, se viene desarrollado en el Grupo de Tecnología del Habla de la Universidad Politécnica de Madrid y que ha dado otros resultados anteriores. Entre ellos, la generación de un sistema de traducción de voz a LSE para la renovación del DNI(1) y el diseño de una herramienta para el aprendizaje de la Lengua de Signos(2), con la colaboración de una alumna del grupo, Ana Huerta Carrillo, que permitió realizar un sistema que permite reconocer los signos y valorar la correcta ejecución de los mismos.

Todos estos resultados obtenidos animan a continuar trabajando en el desarrollo de sistemas similares que acerquen la Administración pública a las personas sordas.

(1) SPEECH COMMUNICATION (ISSN 0167-6393), Vol. 50, 1009-1020, 2008. Speech to Sign Language translation system for Spanish. Rubén San-Segundo, Roberto Barra, Ricardo Córdoba, Luis Fernando D’Haro, Fernando Fernández, Javier Ferreiros, Juan Manuel Lucas, Javier Macías-Guarasa, Juan Manuel Montero, José Manuel Pardo.

(2) IEEE MULTIMEDIA, VOL. 16, P. 81-93, IEEE COMPUTER SOCIETY SignTutor: An Interactive System for Sign Language Tutoring. Oya Aran, Ismail Ari, Alexandre Benoit, Pavel Campr, Ana Huerta Carrillo, François-Xavier Fanard, Lale Akarun, Alice Caplier, Bulent Sankur.